OpenClawブームのその後とHermes Agent

以前OpenClawの何が特別なのか?で、セルフホストできる「自分専用のパーソナルアシスタント」としてOpenClawを取り上げました。Mac miniなどの手元のマシンに住まわせて、TelegramやDiscordから話しかけると雑務をこなしてくれる、常駐型のエージェントです。指示がなくても定期的に自分から動くHEARTBEAT、会話やメモをMarkdownファイルとして手元に貯めていく記憶(メモリ)、再利用できる手順を持たせるAgent Skills。これらの仕組みを自分でいじって試す分には面白いが、安全に使うためのベストプラクティスはまだ定まっておらず過渡期にある、というのがそのときの筆者の評価でした。

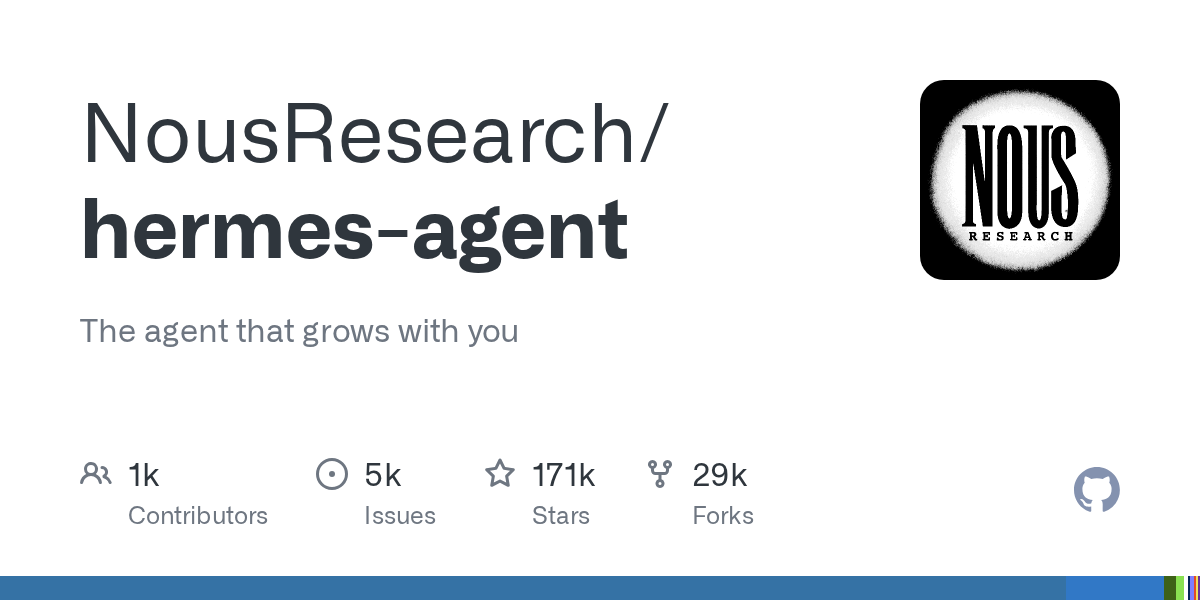

本記事はその続報にあたります。OpenClawのバイラル化の後、PicoClawやnanobotなどの小型のフォロワーが次々と現れました。Nous ResearchのHermes Agentもそうした流れのなかにあります。2026年5月時点で、フォロワー群の多くがスター2〜3万規模なのに対し、Hermesは約17万スターと、フォロワー群のなかでは頭ひとつ抜けています(とはいえ本家OpenClawの約37万には届きません)。この種のニッチなエージェントには一通り目を通すようにしているので、今回はHermes v0.14.0を動かし、ソースコードを読みました。OpenClaw側の設計の詳細は前記事に譲り、ここでは両者の対比と、ブームの後に何が起きているかを見ていきます。

HermesやOpenClawが結局のところ使えるのかどうかだけを持ち帰りたい読者のために、先に結論を書いておきます。いまHermesやOpenClawを自前で動かす価値は、エンドユーザーとして使うことにはほとんどありません。自前で常駐させてパーソナルアシスタントを育てる体験の一部は、すでにCodex appやClaude Coworkが取り込みつつあり、自宅のMac miniやVPSを立てて自分で運用する理由は薄れてきています。それでも触る意味があるとすれば、自分で拡張できる人が、収束していく先のパーソナルアシスタントの姿を、自分の手で先に組み立てて確かめておくことでしょう。HermesはNous PortalとDeepSeekの無料枠で費用ゼロから試せるので、その実験台としては手を出しやすい部類です。

各ツールの機能を並べると、こうなります。

| OpenClaw | Hermes | Claude(Cowork) | Codex(app) | |

|---|---|---|---|---|

| デスクトップ操作 | Peekaboo(自前OpenClaw.app経由) |

computer_use(cua-driver) |

Coworkが画面を直接クリック・タイピング | Computer Use(@Computer) |

| ブラウザ操作 | CDP+Playwright | agent-browser/Camoufox | Chrome拡張 | アプリ内ブラウザ/Chrome拡張 |

| 記憶(手元に自動保存) | ~/.openclawのMarkdown |

~/.hermes/のUSER.mdほか |

auto memory(~/.claude/projects/) |

Memories(~/.codex/memories/) |

| 常駐・リモート操作 | コンパニオンアプリ/Telegram・Discord | Telegram・Discord等 | スマホがリモコン | デスクトップ上で動作 |

| 実行環境 | ホスト(母艦) | ホスト(母艦) | VM [^cowork-host] | ホスト(アプリ) |

| 動かし方 | OSS(セルフホスト、マネージドhostも[^oc-host]) | OSS(セルフホスト) | プラットフォーマー純正 | プラットフォーマー純正 |

[^cowork-host]: CoworkはVMを基本とするが、画面を直接操作するComputer UseやChrome拡張によるブラウザ操作は、原理的に手元のPCで動作

[^oc-host]: OpenClaw-as-a-serviceとして、Alibaba CloudやTencent Cloud、Kimi Clawなどがマネージドホスティングでも提供

上の段(デスクトップ操作・ブラウザ・記憶・常駐リモート)はおおむね横並びで、HOWが違うだけです。差が出るのは下の段、純正アプリかOSSで拡張可能か、母艦のPCで動かすか隔離されたVMやサーバーかという点に絞られてきています。

セッション型と常駐プロセス型

HermesやOpenClawがどういう位置にいるのかは、ライフサイクルで考えるとわかりやすいです。セッション型は、こちらが呼んで初めて動き、その会話で得たことは別の会話には引き継がれません。Claude CodeやCodexがこれで、もともとはコーディングに特化したエージェントでした。常駐プロセス型は、起動したら住み着いて、指示がなくても自分から動き続けます。HermesやOpenClawがこれで、前記事で触れたHEARTBEATがその自律起動の中心となる仕組みでした。コーディングに限らず雑務全般を頼むパーソナルアシスタントとして使われています。

このライフサイクルには、かつて「記憶を自動で貯められるか」という差も重なっていました。常駐型は会話の経験を自動でMarkdownファイルへ書き溜め参照します。セッション型は基本的にプロジェクト内のファイル読み込みのみで、会話をまたぐと忘れる、という対比です。ところが今ではこの差は曖昧になってきました。Claude Codeは訂正や好みを自分で書き溜めるauto memory(~/.claude/projects/に置かれ、毎セッションの冒頭で読み込まれます)を持ち、Codexも同種のMemories(~/.codex/memories/)を備えています。どちらも、HermesがUSER.mdに好みを記録するのと仕組みとしては同型で、ホームディレクトリの下にエージェントが自分でテキストを書き溜める、という形まで揃っています。

記憶だけではありません。冒頭の表のとおり、ブラウザの自動操縦も、手元のデスクトップ操作も、スマホからのリモート操作も、常駐型が持っていた機能はおおむね出揃っています。コーディングエージェントだったClaude CodeやCodexが、Codex appやClaude Coworkというデスクトップアプリの姿を得てOpenClawの領域に寄ってきた、ということです。残るのは機能の差ではなく、セルフホストできるOSSか、プラットフォーマーの純正かという形態の差のほうです。

Hermes Agentとは

Hermes AgentはNous Research製のMITライセンスのOSSエージェントです。開発元のNousはモデル企業、オープンウェイトLLMの研究ラボで、「Hermes」は元々そのモデルファミリーの名前でした。Hermes Agentは2026年2月にリリースされた派生プロダクトにあたります。

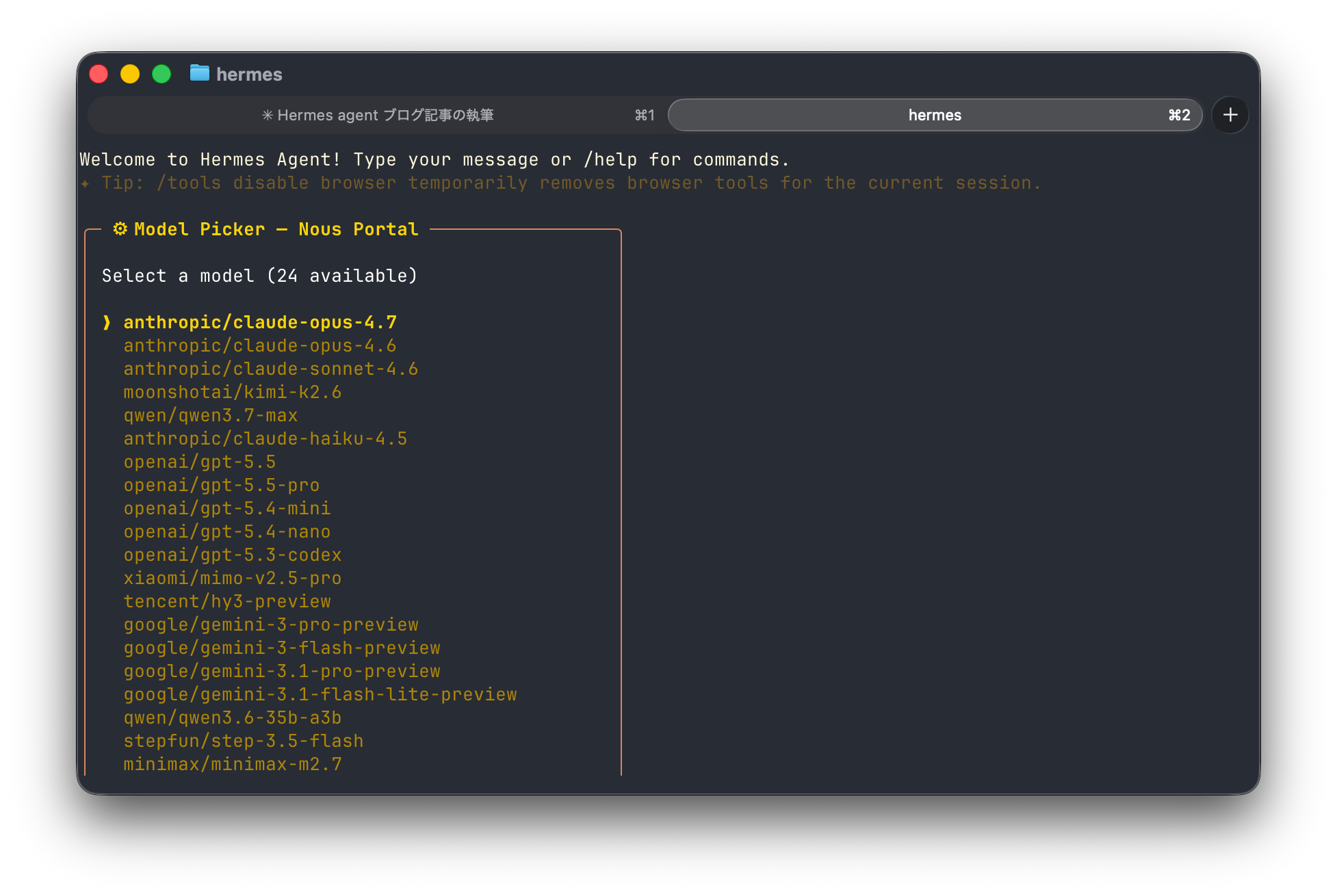

モデル企業が作ったパーソナルアシスタントなら、当然自社モデルを使わせる導線なのだろうと思って中を覗いたのですが、そうとは言い切れませんでした。hermes modelでモデル選択メニューを開くと、選べるのはClaude、GPT、Gemini、Qwen、Kimi、Grok、DeepSeekといった他社モデルばかりで、Hermes AgentのModel Pickerに表示される一覧にNous自身のモデルは入っていませんでした。Nous Portal自体にはNous製のHermes 4(70B/405B)が用意されていますが、Agent内のModel Pickerには出てこない作りです(Hermes Agent docs)。

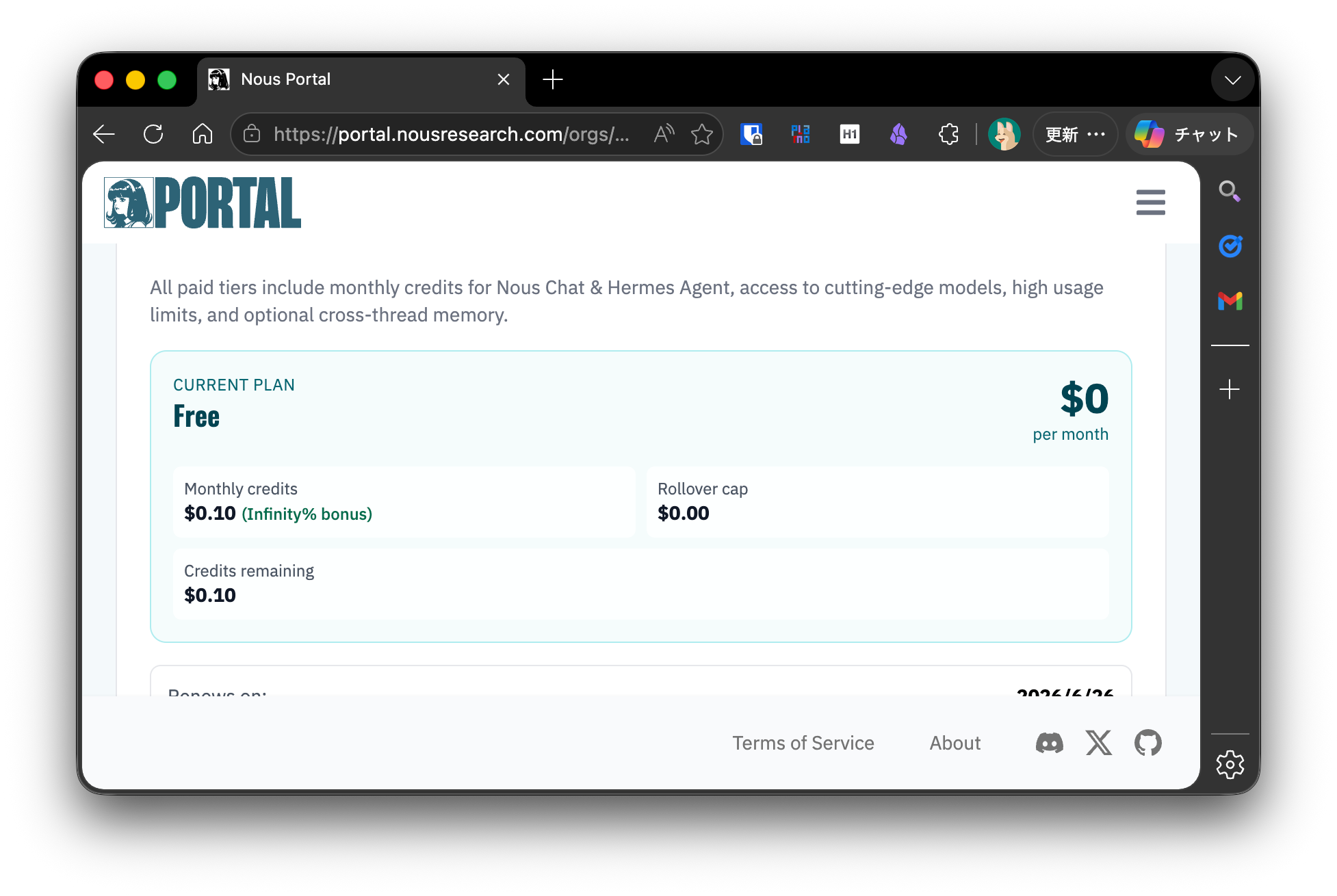

つまりNous Portalは自社モデルを売る場ではなく、他社モデルをプロキシしてホストし、課金をNousサブスク1本に寄せるアグリゲータとして機能しています。既定の無料モデルであるDeepSeekも、このPortal経由で引いています。

無料で試したいだけなら、お金を一切かけずに動かす手があります。hermes auth add nousを実行するとブラウザが開き、Nous Portalで表示されたコードを承認すればログインできます。あとは起動後に/modelでモデル選択メニューを開き、メインモデルに料金が無料のモデルを当てるだけです。筆者の環境ではDeepSeekのdeepseek/deepseek-v4-flash:freeが選べました。設定値は~/.hermes/config.yamlのmodelセクションに書かれ、トークンの類は~/.hermes/.envに分けて保存されます。どのモデルが無料扱いかは、固定リストではなくPortalの料金情報から都度判定される仕様なので、ここは今のところの話だと見ておくのが無難です。

Hermesが前面に打ち出すのは、セッションを超えて記憶を保つ永続性と、経験からSKILL.mdを自動生成する自己改善です。後者をNousは最も推しています。モデルを自由に繋ぎ替えられるモデル非依存も挙げていますが、これはこの種のツールでは当たり前で、取り立てて差別化にはなりません。

一方、コアコンポーネントを除けば、実装の中身は外部ツールとの統合です。独自に作った部品は少なく、外部ツールを束ねてひとつの体験にしています。たとえばブラウザ操作は、既定ではローカルChromiumを駆動するvercel/agent-browserを使い、設定で明示的に有効化すればアンチ検出特化のCamofox(jo-inc/camofox-browser。FirefoxフォークのCamoufoxをラップしたNode.jsサーバー)に差し替えられます。ほかにもターミナルの安全スキャンTirith(sheeki03/tirith)、macOSのデスクトップ操作をMCP経由で担うcua-driverなどを取り込んでいます。

記憶も同じ作りです。既定ではMEMORY.mdとUSER.mdというローカルのMarkdownに貯める素朴な仕組みですが、ここに外部のメモリサービスを差し込めます。hermes memory setupで選べる外部プロバイダは8つあり、サーバー側で会話から事実を抽出するMem0、知識グラフで長期記憶を組むHindsightなど、記憶層まで外部に任せられます。これは自前で大きく作り込むOpenClawとのアーキテクチャ選択の違いです。

OpenClawとの違い

公開リリースの順で見れば、Hermesは後発です。OpenClawはClawdbotとして2025年11月に公開され、2026年1月頃に一気にバイラル化しました。Hermesの公開は2026年2月25日です。プロジェクトの規模でもOpenClawが先行しています。スターはOpenClawが約37万、Hermesが約17万で、コード規模はOpenClawがおよそ3倍です。

後発とはいえ、両者は無関係な似たツールではなく競合関係にあります。互いに乗り換えコマンド(openclaw migrate hermes/hermes claw migrate)を実装し、相手の設定・記憶・スキルをインポートできることからもそれが分かります。

機能面はほぼ横並びでした。メモリ学習も自動スキル生成もOpenClawは持っています。前者はOpenClawの"Dreaming"、後者はSkill Workshopプラグインで、いずれもHermesと似た仕組みです。安全機構もどちらも持っていて、既定をどこで締めるかが違うだけです。

設計思想は対照的ですが、どちらが優れているという話ではありません。OpenClawはTypeScriptとPiベースの実装で、多チャンネルの土台に加えてmacOS/iOS/Androidのコンパニオンアプリ、Canvas、Gatewayまわりまでを自前で大きく作り込んでいます。HermesはPythonでコアを薄く保ち、ツールの実体を外部ツールやSaaSに寄せています。

なのでHermesの実体的な独自性は、自動スキル生成そのものではなく、それをプロダクトの中心に据えた思想と、Nous Portalというアグリゲータが多社のモデルとツールを1つのサブスクに束ねている点に絞られます。実質的な差別化点は後者でしょう。

両者は相手の設定や記憶・スキルをインポートし合うところまでやっています。エージェンティックな開発で実装が高速化した今、片方が出した機能はもう片方が開発コストほぼゼロで追随できる時代です。機能の一覧表で優劣を競っても長くは続かず、残るのは外部サービスとのインテグレーションのようなウェットな領域になってきました。

Hermesを安全に使うには

Hermesを動かして気になった点が2つあります。どちらもデフォルト設定のまま、筆者のローカル環境で起動した実機で再現したものです。

ひとつめは、ローカルPCにある他のツールの認証を自動で拾う挙動です。hermesを起動するだけで、プロバイダがautoのまま、ローカルにある有効な認証を総当たりで検出する仕様になっていました。copilot-cli経由のgh auth token、macOS Keychain内のClaude CodeのOAuthトークン、環境変数のAPI_KEY含め拾います。筆者の環境では、起動時にローカルのClaude Code Maxアカウントの認証が拾われ、そのままAnthropicのAPIが叩かれていました。

サブスク認証をこうして流用するのはそもそも利用規約違反にあたります。しかもAnthropicは2026年6月15日から、Agent SDKやclaude -p、サードパーティアプリによるプログラム利用を、専用の月間クレジット(API実価格・繰越なし)として切り出すと告知しています(本記事執筆時点ではまだ未適用)。

これが適用されれば、本人の知らないところで拾われた認証経由のプログラム利用が、6月以降は意図しない課金につながりかねません。設定で止めること自体はできます。ただ、ひと起動でKeychainの認証まで読み取りにいく設計そのものが治安が悪く、こういう挙動をするツールは最初から認証資産のない隔離した環境で使い始めるのが筋でしょう。

ふたつめは、自己改善の機構そのものに潜む問題です。Hermesは裏でレビュー処理を走らせ、会話の経験からSKILL.mdやUSER.mdを自動で書き換えます。問題は、ここに人間の承認が挟まらないことです。生成されたスキルは誰の確認も経ずに書き込まれ、次のターンの冒頭からそのままシステムプロンプトに載ります。スキル生成時の内容スキャンを有効にする設定(guard_agent_created)は既定でオフですが、これを有効にしてもスキャンが付くだけで、人間が中身を見て承認する段階はやはりありません。

つまり、会話に流入した悪意あるテキストが、自動でスキルに書き込まれ、以降のセッションのシステムプロンプトに居座り続ける経路が成立します。一度書き込まれれば、本人が気づかないまま注入された指示が有効になり続けます。

これは杞憂ではありません。筆者の環境では、ツールの動作を確認していたら、Hermesがskills/system/hermes-tools-debugging/references/x-search-credentials.mdというスキルを勝手に作っていました。そこには認証状態を調べる手順として、cat ~/.hermes/auth.jsonでトークンの内部構造を見る、という指示まで書き込まれていました。こちらが頼んだのは動作確認だけで、認証ファイルを読めとは言っていません。悪意がなくてもこうなるのですから、悪意ある入力が混じればどうなるかは想像がつきます。

対策は、信頼できない入力を扱うなら自動生成そのものを止めることです。~/.hermes/config.yamlでskills.creation_nudge_intervalとmemory.nudge_intervalを0にすれば発火しなくなります。

Hermesに安全機構がないわけではありません。スキル・メモリの内容スキャンや、レビューを隔離プロセスで走らせる仕組みは用意されています。問題は、それらの既定値が緩い側に振れていることで、安全に使うには自分で締め直す手間がかかる、という話です。

ここまでの2点を踏まえると、対策の総論はOpenClawと変わりません。母艦のmacOSで直に動かすのではなく、ターミナルのバックエンドをDockerやSSH先に向け、使い捨てのVMや隔離したマシンで走らせるのが無難です。認証も記憶もスキルも、壊れて困らない環境に閉じ込めておく、という構えです。

本当に使うほど賢くなるのか?

Nousがいちばん前に出しているのが、この自己改善です。公式READMEはHermesをこう説明しています。

It's the only agent with a built-in learning loop — it creates skills from experience, improves them during use, nudges itself to persist knowledge, searches its own past conversations, and builds a deepening model of who you are across sessions.

(このエージェントの最大の特徴は、学習ループが組み込まれている点です。経験からスキルを自動生成し、使用しながら継続的に改善します。また、知識を保持するための適切なタイミングでユーザーを誘導し、過去の会話履歴を検索することで、セッションを重ねるごとにユーザーの特性を深く理解するモデルを構築していきます。)

経験からスキルを作り、使ううちにそれを改善し、あなた像をセッションをまたいで深めていく、という触れ込みです。使うほど賢くなる、と言い換えてもよいでしょう。

これが実機でどう起きるのかを見ていきます(注:短期間の観察とソース確認に基づく話で、長期に育つかどうかまでは検証できていません。)。

はじめに用語を補っておきます。Hermesの言う学習や自己改善は、機械学習ではありません。モデルの重みは変わらず、実態はプロンプトやスキル(SKILL.md)といったテキスト資産を、LLM自身に書き換えさせることです。自己進化エンジンもNous自身が、GPUを使った機械学習は不要でテキストを変異させて選ぶだけだと説明しています(hermes-agent-self-evolution README)。モデルが賢くなるのではなく、自分用のプロンプト資産が積み上がっていく、と捉えるのが正しいです。

それを実際に観察できたのは、二通りの挙動でした。一方は好みの学習で、これは自動で発火しました。ホームディレクトリ直下にファイルを置かないでほしいと訂正した直後に💾 User profile updatedが表示され、その好みがUSER.mdに記録され、次の作業でログ出力先がひとりでに変わったのです。数日使った~/.hermes/memories/USER.mdは、こんな内容に育っていました。

Prefers files NOT placed directly under home directory (~/). Use subdirectories like ~/Documents/research/ instead.

Primary language is Japanese. Prefers structured data presentation (tables, fact-check format) over verbose prose.

Interested in AI agent platforms (Hermes Agent, OpenClaw). Has done deep technical research comparing them, including reading source code.

Commands are direct and action-oriented — prefers concise execution over explanatory prelude.

(ホームディレクトリ直下(~/)に配置されていないファイルを優先します。代わりに ~/Documents/research/ のようなサブディレクトリを使用してください。

主要言語は日本語です。冗長な文章よりも、表形式やファクトチェック形式のような構造化されたデータ表示を好みます。

AIエージェントプラットフォーム(Hermes Agent、OpenClaw)に関心があります。これらを比較した詳細な技術調査を実施しており、ソースコードの読解も行っています。

指示は直接的で行動指向型です。説明的な前置きよりも、簡潔な実行を好みます。)

訂正した好み(保存先にホーム直下を避ける)だけでなく、日本語を使うこと、表やファクトチェック形式を好むこと、本記事のためにソースコードを読んで比較していること、といった筆者の嗜好が、こちらが書き出さないまま溜まっていました。

もう一方のスキルの自動生成は、使い捨てタスクでは起きなかったのですが、明示的に指示するとdeepseek/deepseek-v4-flash:freeでも生成しました。実際に~/.hermes/skills/には、システム統計の取得(daily-system-stats)やツールのデバッグ(hermes-tools-debugging)、ブログ記事のレビュー(blog-article-review)といったスキルが、使ううちに溜まっていました。

この自動更新は、前節のインジェクション経路と表裏一体です。好みを書き込むのも注入文を書き込むのも、同じ隔離レビューをreview_memoryとreview_skillsで呼び分けているだけで、覚えてくれる便利さと書き込まれてしまうトレードオフだと思います。

おわりに

ここまでの話を踏まえると、HermesとOpenClawの選び方は単純です。そもそも雑務を頼みたいだけなら、Codex appやClaude Coworkの発展を待つのが賢明で、自分専用のパーソナルアシスタントを自宅のMac miniやVPSで育てたい人だけが両者の対象になります。そのうえでHermesを選ぶとすれば、外部サービスを差し込んで拡張したい場合でしょう。OpenClawが自前で作り込むのに対し、Hermesはモデルもメモリもツールも外部に開いているからです。とはいえ規模でもコミュニティでもOpenClawが先行していて、Hermesはそのオルタナティブの一つにとどまります。

どちらにせよ、HermesもOpenClawも収束が完了する前に現れたセルフホスト型のOSSで、その体験の一部はいずれプラットフォーム側に取り込まれていくと考えられます。触る価値があるとすれば、近い将来あたりまえになるパーソナルアシスタントの中身を、いま自分の手で理解しておくことにあります。